Em 3 de fevereiro de 1966, um objeto do tamanho de uma bola de praia caiu na superfície da Lua e quicou. Duas vezes. Depois parou, abriu quatro pétalas metálicas como uma flor mecânica e, quatro minutos mais tarde, começou a transmitir as primeiras fotografias panorâmicas já feitas a partir do solo de outro mundo. A sonda Luna 9, lançada pela União Soviética, havia acabado de provar que um pouso suave no nosso satélite natural era possível — e que a superfície lunar não engoliria máquinas em um mar de pó fino, como alguns cientistas temiam. Foi um triunfo tecnológico que mudou para sempre a corrida espacial. Mas a própria Luna 9, o artefato físico que realizou essa façanha, desapareceu. Ninguém sabia exatamente onde ela estava. Até agora.

Uma equipe de pesquisadores do Reino Unido e do Japão acaba de publicar, no periódico npj Space Exploration, um estudo que pode ter resolvido esse mistério de seis décadas. Usando um algoritmo de inteligência artificial chamado YOLO-ETA — uma sigla para You Only Look Once, Extraterrestrial Artefact —, Lewis J. Pinault, Ian A. Crawford e Hajime Yano vasculharam imagens de alta resolução da câmera da sonda Lunar Reconnaissance Orbiter e identificaram um agrupamento de objetos artificiais a cerca de cinco quilômetros das coordenadas históricas atribuídas ao pouso da Luna 9. O local candidato, próximo a 7,03° N e 64,33° O, apresenta características espaciais, morfológicas e topográficas compatíveis com o que se espera encontrar nos restos daquela missão pioneira.

A história por trás dessa busca é tão rica quanto o próprio achado. E para entendê-la, precisamos voltar àquela noite de fevereiro de 1966, quando engenheiros soviéticos prenderam a respiração em salas de controle cobertas de fumaça de cigarro, esperando o sinal de uma sonda que atravessava o vácuo a caminho de Oceanus Procellarum.

O programa lunar soviético era, naquela altura, uma máquina de tentativas e erros alimentada por ambição política e genialidade técnica em partes iguais. A série Luna havia acumulado fracassos espetaculares ao longo dos anos anteriores. Sondas se despedaçaram contra a superfície, perderam contato no trajeto, ou simplesmente falharam no lançamento. Luna 4, 5, 6, 7 e 8 — todas tentaram pousar com suavidade e todas falharam, de um jeito ou de outro. O conceito por trás da Luna 9 era engenhoso na sua brutalidade controlada: a espaçonave principal se aproximaria da Lua em alta velocidade, desaceleraria com motores de frenagem, e nos últimos metros antes do impacto ejetaria uma cápsula esférica envolta em airbags. A cápsula quicaria, os airbags a protegeriam, e depois de estabilizar ela abriria suas pétalas estabilizadoras e antenas de comunicação. Enquanto isso, o módulo de voo principal, já sem combustível, cairia em algum lugar nas proximidades, provavelmente a cem ou duzentos metros dali.

Funcionou. A Luna 9 transmitiu imagens panorâmicas do solo lunar que mostravam um horizonte surpreendentemente plano, com rochas espalhadas e crateras rasas ao redor. As fotografias foram interceptadas pelo Observatório de Jodrell Bank, na Inglaterra, antes mesmo que a agência soviética as publicasse — um detalhe delicioso da Guerra Fria que acrescentou drama a um feito já dramático por natureza. Mas apesar de todo o registro fotográfico e dos dados de telemetria, a localização precisa do pouso sempre permaneceu nebulosa. As coordenadas oficiais soviéticas, publicadas em diversos relatórios ao longo das décadas, apontavam para a região de 7,08° N e 64,37° O, mas com margens de incerteza consideráveis. Tentativas posteriores de localizar a sonda em imagens orbitais nunca produziram uma identificação confirmada.

E aí mora o problema que Pinault, Crawford e Yano decidiram atacar. A Lua, vista de cima, é um lugar monótono para olhos humanos procurando objetos do tamanho de uma geladeira em meio a milhões de quilômetros quadrados de regolito cinzento. A câmera de ângulo estreito da Lunar Reconnaissance Orbiter, a NAC, fotografa a superfície lunar continuamente desde 2009, gerando um arquivo com mais de dois milhões de imagens em resoluções que vão de meio metro a um quarto de metro por pixel. Nesse nível de detalhe, os estágios de descida das missões Apollo aparecem como manchas brilhantes do tamanho de poucos pixels, cercadas por rastros deixados por astronautas e jipes lunares. As sondas soviéticas, menores e sem o benefício de trilhas humanas ao redor, são alvos ainda mais esquivos.

O YOLO-ETA nasceu de um ancestral improvável. Lewis Pinault e Hajime Yano já haviam desenvolvido, anos antes, um sistema chamado YOLO-ET — sem o A de Artefact — projetado para algo completamente diferente: identificar e classificar micropartículas capturadas em painéis de aerogel de sílica do experimento Tanpopo, instalado no módulo japonês Kibo da Estação Espacial Internacional. O Tanpopo coletava partículas cósmicas e detritos em órbita, e a tarefa de encontrar e classificar grãos microscópicos em meio ao aerogel era perfeita para redes neurais convolucionais compactas. O algoritmo, baseado na arquitetura TinyYOLOv2, era leve o suficiente para rodar em hardware com recursos computacionais limitados — uma característica pensada para futuras aplicações em sistemas embarcados a bordo de espaçonaves.

A transição do microscópico para o macroscópico pode parecer um salto estranho, mas a lógica computacional é a mesma. Uma rede neural convolucional aprende a reconhecer padrões de contraste, geometria e textura em imagens, independentemente da escala. Se o YOLO-ET conseguia distinguir uma partícula extraterrestre de um contaminante em uma imagem de microscópio, o YOLO-ETA poderia, em princípio, distinguir um módulo de pouso de uma cratera em uma imagem orbital. A diferença estava nos dados de treinamento e na calibração dos hiperparâmetros, não na arquitetura fundamental do modelo.

Para treinar o YOLO-ETA, a equipe reuniu 125 imagens de alta resolução dos locais de pouso das missões Apollo, de Apollo 11 a Apollo 17. Cada imagem foi anotada manualmente usando uma ferramenta de demarcação de caixas delimitadoras. Os objetos foram classificados em três categorias: módulos de pouso, veículos lunares de exploração e um agrupamento chamado “outro hardware”, que englobava sismômetros, pacotes ALSEP e até bandeiras — objetos pequenos demais, com poucos pixels nas imagens, para serem distinguidos individualmente pelo modelo. Técnicas padrão de aumento de dados foram aplicadas: espelhamentos horizontais e verticais, rotações de noventa graus e recortes aleatórios de mil por mil pixels. O conjunto final, após o aumento, chegou a cerca de 1580 imagens, divididas em oitenta por cento para treinamento e vinte por cento para teste.

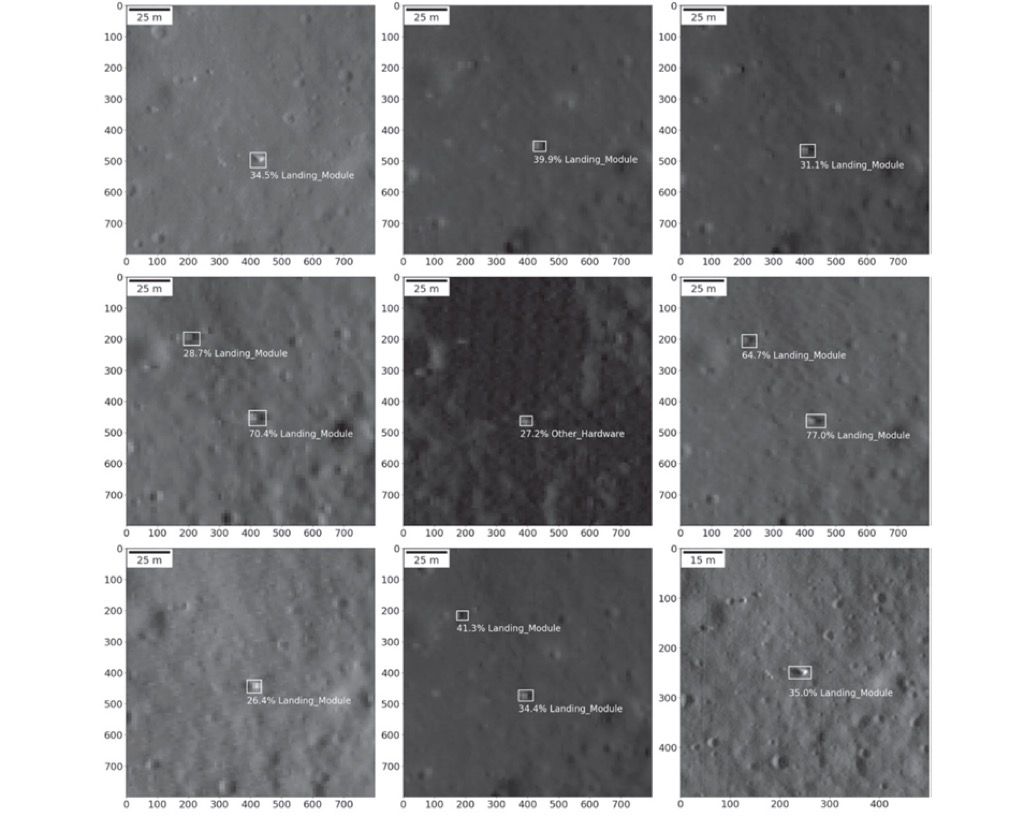

O treinamento convergiu em quinhentas iterações com um tamanho de lote de 32 imagens, alcançando uma perda final de 0,92, o que corresponde a aproximadamente oito por cento de erro geral de predição. Na avaliação com o conjunto de teste — 317 imagens que o modelo nunca tinha visto —, o YOLO-ETA apresentou um desempenho equilibrado entre precisão e revocação, com um F1 combinado de aproximadamente 0,60. Para módulos de pouso especificamente, a revocação atingiu 91 por cento, com uma confiança média de 80 por cento, o que significa que o algoritmo encontrava a grande maioria dos módulos reais e, quando os encontrava, estava razoavelmente seguro da classificação. Objetos menores, como veículos e equipamentos diversos, tiveram desempenho inferior, reflexo do número limitado de pixels que ocupam nas imagens e da decisão deliberada de calibrar o modelo para alta sensibilidade, aceitando uma taxa moderada de falsos positivos que seriam depois filtrados por verificação humana.

A primeira prova de fogo veio com imagens inéditas do sítio de Apollo 17, capturadas sob ângulos de iluminação solar que o modelo nunca havia processado. O YOLO-ETA localizou corretamente o estágio de descida do módulo lunar com confiança de até 83 por cento. Em certas condições de luz, o algoritmo agrupava a sombra alongada do módulo junto com o próprio hardware como uma detecção única — um comportamento que revela a sensibilidade da rede a fronteiras de contraste nítido. Sob iluminação mais escura, o modelo também identificou o jipe lunar e equipamentos auxiliares, embora com confiança mais baixa. Houve falsos positivos, como uma pedra que o algoritmo classificou como hardware na imagem de Apollo 17, mas esses casos foram interpretados pela equipe como indicadores da sensibilidade do modelo a padrões de geometria de sombra e contrastes de albedo, e não como falhas fatais.

O teste mais revelador, porém, foi a aplicação do modelo a um alvo completamente fora do conjunto de treinamento: a sonda Luna 16, a primeira missão robótica a coletar e trazer de volta amostras de solo lunar, que pousou no Mare Fecunditatis em setembro de 1970. O YOLO-ETA nunca tinha visto qualquer espaçonave soviética durante o treinamento — apenas hardware americano das missões Apollo. Mesmo assim, ao processar imagens LROC do sítio da Luna 16, o algoritmo detectou e localizou corretamente a sonda, classificando-a como um módulo de pouso com confiança de até 77 por cento. Essa validação cruzada demonstrou algo poderoso: o modelo não estava memorizando a aparência específica dos módulos Apollo. Ele havia aprendido pistas visuais mais gerais — padrões de contraste radiométrico e espacial que caracterizam objetos artificiais em superfícies naturais —, e essas pistas eram transferíveis para espaçonaves de design completamente diferente.

Um teste adicional com a Surveyor 7, uma sonda americana que pousou em janeiro de 1968 em um terreno repleto de rochas e pedregulhos, reforçou essa conclusão. Mesmo sem retreinamento, o YOLO-ETA identificou a Surveyor 7 com confiança superior a 58 por cento em meio a um campo de pedras que tornaria a detecção manual extremamente difícil. O algoritmo parecia estar decodificando os padrões de sombra distintos da espaçonave mesmo entre os pedregulhos circundantes.

Com essas validações na mão, a equipe direcionou o YOLO-ETA para o objetivo principal do estudo: encontrar a Luna 9. A busca se concentrou em uma área de cinco por cinco quilômetros ao redor das coordenadas históricas do pouso, usando a ferramenta QuickMap do LROC para acessar imagens da câmera de ângulo estreito em diferentes condições de iluminação e ângulos de incidência. Vários objetos brilhantes visíveis a olho nu na região foram analisados pelo modelo e descartados como crateras recentes — uma distinção que reforça a capacidade do algoritmo de filtrar feições naturais. Mas ao expandir a busca para além do centro da área canônica, o YOLO-ETA fez sua primeira detecção: um objeto classificado como módulo de pouso a 7,029° N e 64,329° O, com confiança de 43,8 por cento, na imagem LROC M132071202LC.

Essa confiança inicial, abaixo de cinquenta por cento, poderia ter sido descartada como ruído. Mas Pinault e seus colegas notaram algo. Perto do objeto principal, a menos de duzentos metros, havia outros objetos menores de aparência igualmente distinta. E quando os pesquisadores buscaram imagens adicionais da mesma região — trinta e uma imagens LROC no total, das quais oito tinham resolução e iluminação adequadas para inferência —, o YOLO-ETA detectou o mesmo objeto principal em todas as oito, com confiança variando entre 60 e 77 por cento. A persistência da detecção sob geometrias de iluminação independentes é um indicador robusto de que o algoritmo estava identificando estruturas reais e permanentes, não artefatos ópticos criados por condições de luz específicas.

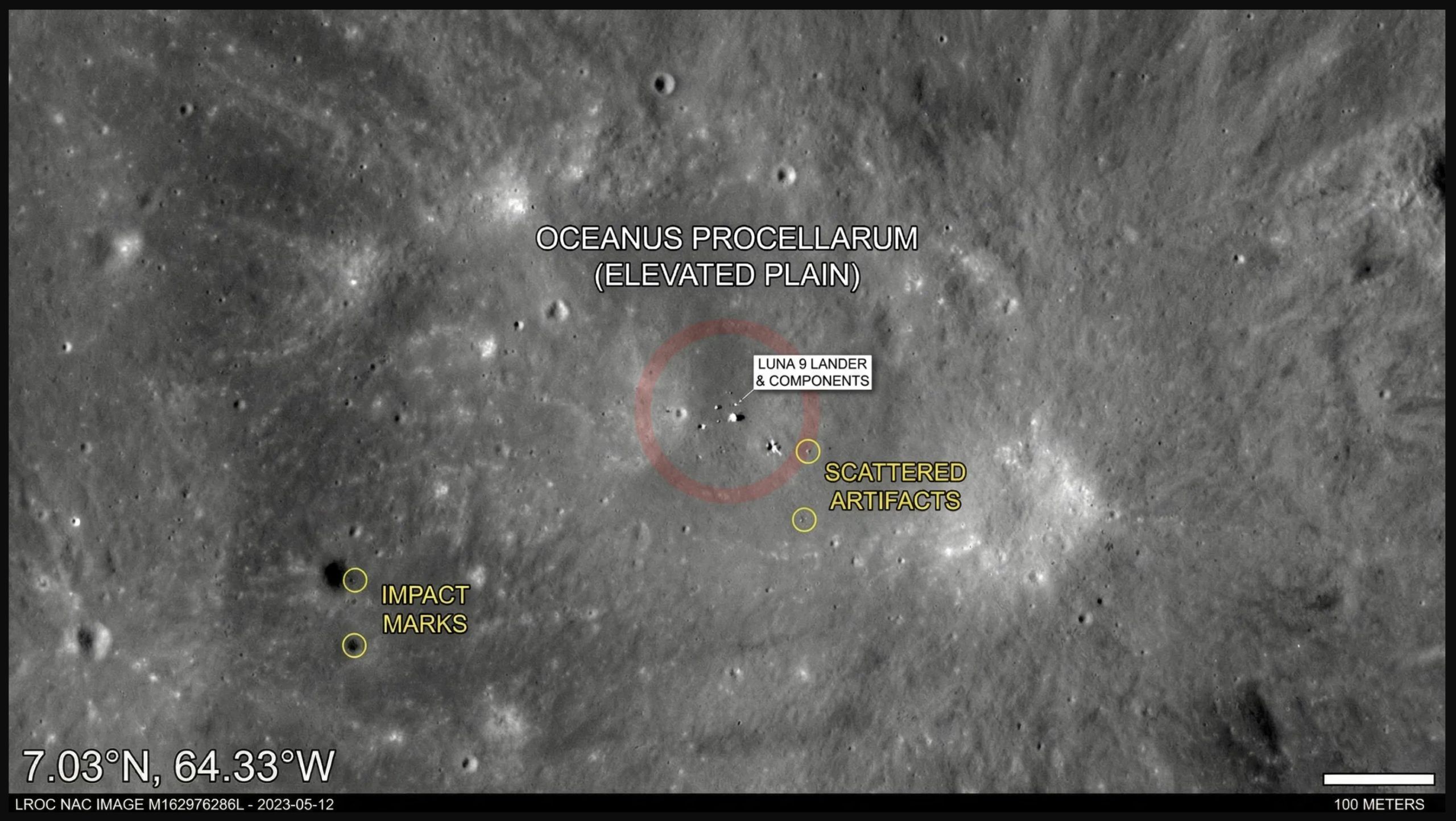

A distribuição espacial dos objetos detectados encaixa no que se sabe sobre a sequência de pouso da Luna 9. Os registros históricos descrevem que a espaçonave principal ejetou seus módulos laterais e lançou a cápsula envolta em airbags a cerca de cinco metros da superfície. As pétalas estabilizadoras e antenas foram implantadas minutos depois do toque, enquanto o estágio de voo, sem propulsão, deve ter impactado entre cem e duzentos metros adiante. As múltiplas detecções do YOLO-ETA dentro desse raio de distância poderiam corresponder ao módulo pousado e seus componentes ejetados. Dois pontos escuros incomuns, de quarenta e sessenta metros ao sul-sudoeste da detecção principal, coincidem com pequenas crateras de cinco e sete metros visíveis apenas sob ângulos solares elevados. Os pesquisadores especulam que essas marcas poderiam ser os sítios de impacto dos módulos laterais da sonda, que pesavam cerca de 150 quilogramas cada e teriam caído em queda livre balística a quase quinhentos metros por segundo, fragmentando-se e alterando significativamente o albedo do regolito ao redor.

Mas a correspondência espacial dos objetos, por si só, não seria suficiente para construir um caso convincente. O que torna este estudo particularmente interessante é a análise topográfica complementar. As panorâmicas transmitidas pela Luna 9 em 1966 mostram um horizonte chato, sem colinas ou relevos visíveis acima da linha do céu. Essa observação gerou debates ao longo das décadas. Philip Stooke, autor do International Atlas of Lunar Exploration e um dos revisores deste próprio artigo, argumentou que o sonda deve ter pousado longe das colinas proeminentes perto das coordenadas canônicas, onde tais elevações necessariamente apareceriam no horizonte. A localização proposta pela equipe de Pinault resolve essa tensão de forma elegante: perfis de elevação derivados do altímetro laser LOLA indicam que o terreno no sítio candidato está cerca de 25 metros acima do nível do mare adjacente, formando uma planície suavemente elevada. Para uma câmera posicionada a um metro da superfície nesse local, o horizonte geométrico se estenderia a nove ou dez quilômetros, o que significa que qualquer crista com menos de cem metros de altura e a mais de vinte quilômetros de distância ficaria oculta abaixo da linha de visão. A ausência aparente de colinas nas panorâmicas da Luna 9 é consistente com um sítio de elevação modesta cercado por relevo distante.

A equipe foi além e gerou uma renderização tridimensional da imagem LROC M132071202LC usando o servidor de mosaicos do QuickMap, rotacionando a visualização para simular o ponto de vista da câmera da Luna 9. Agrupamentos de crateras e relevo local visíveis nas imagens originais de 1966 mostraram uma correspondência tentativa com feições no sítio candidato. Os possíveis artefatos, rotulados de (a) a (e) no artigo, correspondem à escala e separação aproximadas esperadas entre o estágio de voo, a cápsula de pouso e os componentes ejetados. A distância entre os dois objetos mais proeminentes é de cerca de cinquenta metros, comparável às estimativas feitas a partir das próprias panorâmicas da sonda e de uma análise da Lockheed Electronics de 1968 sobre as fotografias da Luna 9.

Os autores são cuidadosos em não reivindicar uma identificação definitiva. O artigo fala em “possível identificação” no título e repete ao longo do texto que a confirmação exigirá novas imagens direcionadas pela Lunar Reconnaissance Orbiter ou por futuros orbitadores, idealmente sob condições de iluminação repetíveis e em altitudes mais baixas. Observações de radar terrestre ou estudos fotométricos poderiam fornecer evidências adicionais. Essa cautela é apropriada e cientificamente saudável, mas os dados apresentados formam um caso circunstancial forte. As detecções persistem sob múltiplas geometrias de iluminação. As separações espaciais batem com o esperado da sequência de pouso. A topografia é consistente com as panorâmicas históricas. E o modelo passou por validações independentes com Luna 16 e Surveyor 7. Juntas, essas linhas de evidência apontam para o mesmo lugar.

O que talvez seja igualmente significativo, para além da Luna 9 em si, é o que este trabalho demonstra sobre o futuro da exploração planetária automatizada. O YOLO-ETA é um modelo compacto, leve, projetado para rodar em hardware com recursos limitados. Sua arquitetura, herdada do TinyYOLOv2, foi pensada para inferência em tempo real em sistemas embarcados — o tipo de processador que cabe em um CubeSat ou em um rover. A ideia de embarcar redes neurais em sondas orbitais para fazer triagem automática de imagens antes de transmiti-las à Terra não é ficção científica; é uma necessidade prática que se torna mais urgente a cada ano. A largura de banda para comunicação com espaçonaves em órbita lunar é limitada, e à medida que a atividade na Lua se intensifica — com missões comerciais, governamentais e internacionais se multiplicando —, a capacidade de processar imagens a bordo e transmitir apenas o que é relevante será cada vez mais valiosa.

Os pesquisadores identificam três aplicações principais para sistemas como o YOLO-ETA no contexto lunar futuro. A primeira é a catalogação de artefatos históricos e a preservação de sítios de patrimônio lunar. Com dezenas de missões já tendo deixado hardware na superfície e muitas mais a caminho, manter um inventário atualizado e preciso desses objetos é uma questão tanto científica quanto de gestão do espaço. A segunda aplicação é a consciência situacional e o suporte à navegação em ambientes de superfície cada vez mais congestionados. A terceira é o auxílio a investigações científicas sobre perturbação do regolito e modificação de albedo causadas por processos de pouso e impacto — um campo de pesquisa ativo que depende de saber exatamente onde cada evento de pouso ocorreu e qual foi sua magnitude.

Há algo de poeticamente apropriado no fato de que a busca pela Luna 9 tenha envolvido uma colaboração entre instituições britânicas e japonesas. Afinal, foi o Observatório de Jodrell Bank, na Inglaterra, que interceptou as primeiras transmissões de imagem da Luna 9 em 1966, antes mesmo da publicação oficial soviética. O rádio telescópio britânico captou o sinal da sonda e, ao perceber que o formato de transmissão era similar ao de um sistema de telefoto usado por agências de notícias, providenciou um receptor compatível. As imagens que emergiram mostravam um cenário lunar cru e real, sem filtros nem retoques, e correram o mundo. Sessenta anos depois, pesquisadores de Birkbeck College, da University College London e do ISAS da JAXA usam inteligência artificial para tentar encontrar a origem física daquele sinal.

Crawford, coautor do estudo, é uma figura conhecida na comunidade de ciências planetárias. Professor de ciências planetárias e astrobiologia em Birkbeck e pesquisador do Centre for Planetary Sciences UCL/Birkbeck, ele trabalha há anos na interface entre exploração lunar e patrimônio espacial. Yano, do ISAS da JAXA e da Universidade SOKENDAI, trouxe para o projeto a experiência com o experimento Tanpopo e a expertise em detecção de partículas que deu origem ao algoritmo original. Pinault, o primeiro autor, conduziu o trabalho como parte de sua tese de doutorado em Birkbeck, onde pesquisou estratégias de detecção para artefatos extraterrestres na Lua e no sistema solar. Ele também é afiliado ao SETI Institute, em Mountain View, Califórnia — uma conexão que sublinha a dimensão mais ampla desse tipo de pesquisa: a busca por objetos artificiais em ambientes extraterrestres, seja como arqueologia espacial ou como parte de um esforço mais amplo de detecção de tecnossignaturas.

O artigo foi submetido em junho de 2025 e aceito em dezembro do mesmo ano, após revisão por Philip Stooke e dois avaliadores anônimos. O fato de Stooke — o principal estudioso da localização de sítios de pouso lunares históricos e autor do atlas de referência sobre o tema — ter sido um dos revisores e ter endossado a publicação confere peso adicional aos resultados. Em seus próprios trabalhos e em comentários públicos, Stooke já havia argumentado que a Luna 9 não podia estar nas coordenadas canônicas, dados os horizontes planos visíveis nas panorâmicas. A nova localização proposta pelo YOLO-ETA é consistente com essa argumentação.

A relação entre aprendizado de máquina e análise humana especializada é um dos temas implícitos do artigo. O algoritmo faz o trabalho pesado de vasculhar milhares de tiles de imagem e isolar anomalias estatísticas, mas a interpretação física — esta mancha é uma sonda ou uma rocha? esta distribuição de objetos faz sentido dado o que sabemos sobre a sequência de pouso? — permanece no domínio da expertise humana. Os autores enfatizam essa complementaridade e a descrevem como uma abordagem colaborativa já integral ao sensoriamento remoto terrestre e agora madura o suficiente para ser transplantada para arquivos de dados extraterrestres.

Para colocar o desempenho do YOLO-ETA em perspectiva, é útil compará-lo com a abordagem anterior mais relevante. Em 2020, Lesnikowski e colaboradores usaram autoencoders variacionais — um tipo de rede neural não supervisionada — treinados em imagens dos sítios Apollo para tentar identificar tiles que provavelmente continham hardware espacial. O método funcionava como uma espécie de alarme: sinalizava regiões de interesse, mas não fornecia localização precisa nem classificação dos objetos. Exigia poder computacional considerável e não gerava resultados diretamente interpretáveis por analistas humanos. O YOLO-ETA, em contraste, faz detecção supervisionada, localização e classificação em uma única passagem pela rede. O modelo é leve o suficiente para rodar em GPUs padrão, e seu output é imediato: caixas delimitadoras com coordenadas, classes e escores de confiança. Para aplicações orbitais em tempo real, essa diferença é crucial.

Também há limitações que merecem atenção. O conjunto de treinamento é pequeno: 125 imagens originais, mesmo com aumento de dados. O modelo tem dificuldade com objetos muito pequenos, que ocupam menos de dez pixels nas imagens. A taxa de falsos positivos para categorias menores é alta — cerca de 76 falsos positivos combinados contra 69 verdadeiros positivos no conjunto de teste. E a identificação da Luna 9, embora apoiada por múltiplas linhas de evidência, permanece candidata, não confirmada. Os próprios autores reconhecem que a próxima etapa depende de nova imagiologia: passes dedicados da LRO em baixa altitude, sob iluminação controlada, poderiam resolver a questão de maneira quase instantânea.

O contexto mais amplo dessa pesquisa é o de uma Lua que está prestes a ficar muito mais movimentada. O programa Artemis da NASA, as missões Chang’e da China, os pousos comerciais da Intuitive Machines e da Astrobotic, o programa lunar da Índia — todos estão colocando ou planejam colocar hardware na superfície lunar nos próximos anos. O Google Lunar XPRIZE pode ter expirado sem um vencedor, mas a competição que ele inspirou gerou uma indústria. Cada um desses pousos deixará artefatos na Lua. E à medida que a superfície lunar se popula de hardware, a capacidade de mapear, catalogar e monitorar esses objetos de forma automatizada deixa de ser uma curiosidade acadêmica e se torna uma necessidade operacional.

Existe também uma dimensão que poderíamos chamar de arqueológica. A Lua não tem atmosfera, não tem erosão hídrica, não tem atividade tectônica significativa. Os objetos que pousam lá — ou que se estilhaçam lá — permanecem, para todos os efeitos práticos, para sempre. Os sítios de pouso das missões Apollo são cápsulas do tempo da aventura humana no espaço, preservadas com fidelidade que nenhum museu terrestre pode igualar. As sondas soviéticas Luna e Lunokhod, os Surveyors americanos, até os recentes pousos chineses e indianos, todos representam marcos tecnológicos congelados no regolito. Em 2011, a NASA publicou recomendações para a proteção de sítios de patrimônio histórico na Lua, e o assunto tem ganhado atenção crescente em fóruns de direito espacial e política de exploração. Saber onde cada um desses artefatos está é o primeiro passo para qualquer esquema de preservação.

A tese de doutorado de Pinault, defendida em Birkbeck em 2024, abordou justamente esse tema mais amplo: a busca por artefatos extraterrestres na Lua e no sistema solar, com atenção especial a estratégias de detecção e técnicas automatizadas. O trabalho com o YOLO-ETA é a materialização prática dessa pesquisa, e o achado da Luna 9 é a demonstração mais visível de seu potencial. Mas as implicações vão além de encontrar sondas perdidas. O mesmo tipo de modelo, com treinamento adequado, poderia ser usado para detectar impactos recentes de meteoroides, monitorar alterações na superfície ao longo do tempo, ou — e aqui entramos no terreno da especulação responsável — buscar anomalias que não correspondam a nenhum hardware conhecido. Em um sistema solar vasto, com bilhões de anos de história, a hipótese de que algum artefato não humano possa existir em algum lugar não é descabida. É improvável, mas não é descabida. E ferramentas como o YOLO-ETA são exatamente o tipo de sistema que poderia, em princípio, encontrar algo assim — se houver algo para ser encontrado.

Os dados e o código do YOLO-ETA estão disponíveis publicamente em um repositório do GitHub, seguindo os padrões de ciência aberta que permitem reprodução e verificação independente dos resultados. Essa transparência é particularmente importante para uma reivindicação de alto perfil como a possível localização de um sítio de pouso histórico. Qualquer pesquisador com acesso às imagens LROC pode, em princípio, baixar o modelo, rodar os mesmos testes e avaliar por conta própria se as detecções são convincentes.

A confirmação final, quando vier — e há boas razões para acreditar que virá —, não será apenas a resolução de um detalhe histórico obscuro. Será a prova de conceito de que modelos de aprendizado de máquina compactos, treinados com dados limitados, podem descobrir coisas na Lua que décadas de análise humana não conseguiram encontrar. É a demonstração de que a inteligência artificial, quando aplicada com rigor e criatividade, não substitui o olhar humano — ela o complementa, amplia e, às vezes, surpreende.

Há uma ironia bonita no arco dessa história. Em 1966, a Luna 9 nos enviou as primeiras imagens de perto da superfície de outro mundo, transformando para sempre nossa relação visual com a Lua. Em 2026, um algoritmo treinado para ver o que nossos olhos não conseguem distinguir pode ter encontrado a própria máquina que nos deu aquelas imagens. A tecnologia que foi encontrada é a avó distante da tecnologia que a encontrou. E a Lua, paciente e silenciosa, guardou o segredo por sessenta anos, esperando que alguém fosse esperto o suficiente para fazer a pergunta certa ao conjunto certo de pixels.

O que a Luna 9 viu em Oceanus Procellarum naquela manhã de fevereiro de 1966 — o horizonte plano, as rochas dispersas, o solo granulado e firme o bastante para sustentar uma sonda — pode finalmente ganhar coordenadas exatas. E quando o próximo orbitador apontar suas câmeras para 7,03° N e 64,33° O, talvez vejamos, preservados no regolito depois de seis décadas de solidão, os restos da primeira máquina que pousou com delicadeza na superfície de outro mundo. Um punhado de metal, pétalas abertas, antenas estendidas para um céu que nunca respondeu. Ainda lá. Ainda inteira, talvez. Esperando.

Comente!