Nos últimos anos, a tecnologia de inteligência artificial (IA) tem avançado a passos largos, proporcionando inovações que transformam diversos setores da sociedade. Entre essas inovações, destaca-se a criação de deepfakes, uma técnica que utiliza algoritmos avançados para gerar imagens, vídeos e áudios sintéticos que imitam com precisão impressionante os conteúdos reais. Deepfakes são capazes de substituir as características de uma pessoa ou ambiente por outras, criando a ilusão de que indivíduos disseram ou fizeram coisas que, na realidade, nunca ocorreram. Essa capacidade de manipulação visual e auditiva levanta preocupações significativas, especialmente no que diz respeito à disseminação de desinformação e à potencial utilização maliciosa durante eventos críticos, como eleições.

A crescente sofisticação dos deepfakes torna cada vez mais difícil distinguir entre o que é genuíno e o que é fabricado. A autenticidade das imagens e vídeos, que outrora era garantida por simples observação, agora requer métodos mais complexos e rigorosos para ser verificada. Nesse contexto, a necessidade de desenvolver técnicas eficazes para a detecção de deepfakes torna-se imperativa, não apenas para proteger a integridade da informação, mas também para salvaguardar a confiança pública nas mídias visuais.

Em um esforço inovador para enfrentar o desafio dos deepfakes, pesquisadores estão recorrendo a técnicas oriundas da astronomia, tradicionalmente utilizadas para estudar galáxias distantes, a fim de detectar manipulações em imagens digitais. Este cruzamento interdisciplinar entre astronomia e ciência da computação foi recentemente apresentado por Kevin Pimbblet, diretor do Centro de Excelência em Ciência de Dados, Inteligência Artificial e Modelagem da Universidade de Hull, no Reino Unido, durante a Reunião Nacional de Astronomia da Sociedade Astronômica Real do Reino Unido, realizada em 15 de julho de 2024.

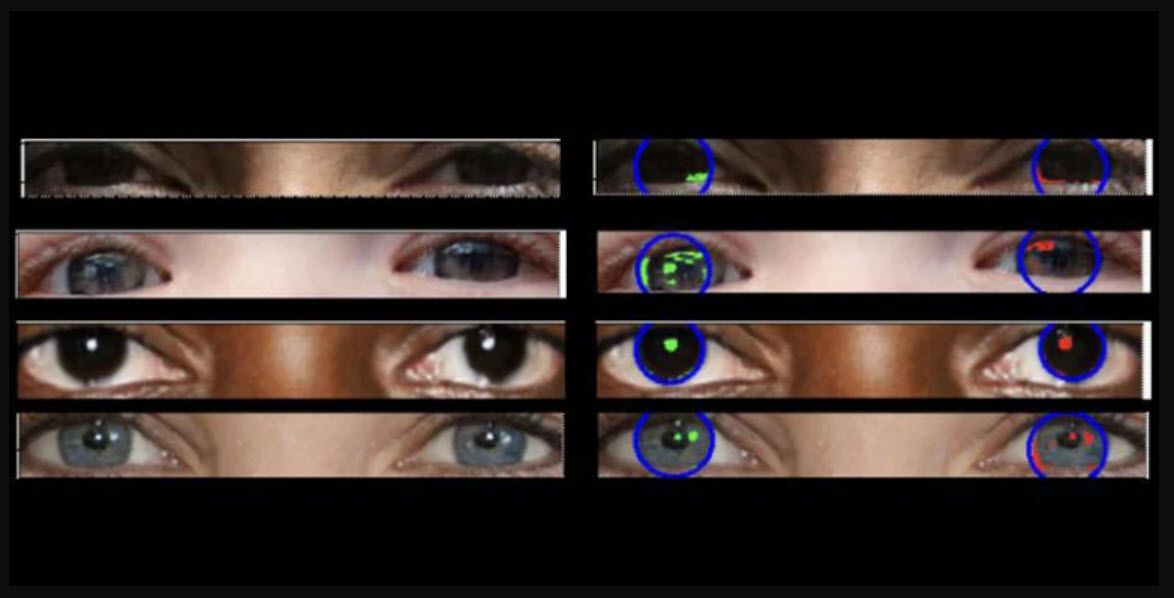

A pesquisa, que também formou a base da tese de mestrado de Adejumoke Owolabi, cientista de dados na Universidade de Hull, explora como a análise das reflexões de luz nos olhos das pessoas pode revelar sinais sutis de manipulação de imagem. Utilizando métodos desenvolvidos para medir a distribuição de luz em imagens astronômicas, os pesquisadores conseguem identificar inconsistências nas reflexões que seriam imperceptíveis ao olho humano. Essas técnicas, que incluem o sistema CAS e o índice de Gini, permitem quantificar características como concentração, assimetria e suavidade da distribuição de luz, oferecendo uma nova abordagem para a detecção de deepfakes.

Embora ainda não seja uma solução infalível, a aplicação dessas técnicas astronômicas representa um passo significativo na luta contra a desinformação visual. A capacidade de identificar deepfakes com uma precisão razoável pode ser adicionada ao conjunto de ferramentas existentes, aprimorando a eficácia dos métodos de verificação e contribuindo para a integridade da informação digital.

A pesquisa conduzida por Kevin Pimbblet e Adejumoke Owolabi inovou ao aplicar técnicas astronômicas na detecção de deepfakes, especificamente o CAS system e o Gini index. O CAS system, utilizado há décadas na astronomia, quantifica a concentração, assimetria e suavidade da distribuição de luz em objetos celestes. Este método tem sido instrumental na caracterização de estrelas extragalácticas, permitindo aos astrônomos discernir padrões complexos de luz que seriam imperceptíveis a olho nu. Por outro lado, o Gini index, uma métrica originalmente desenvolvida para medir a desigualdade de distribuição de renda, foi adaptado para avaliar a distribuição de luz em imagens de galáxias, oferecendo uma perspectiva quantitativa sobre a uniformidade ou irregularidade da luz.

A aplicação dessas técnicas na detecção de deepfakes envolveu a análise das reflexões de fontes de luz nos olhos das imagens. Owolabi utilizou um conjunto de dados de imagens reais do Flickr-Faces-HQ Dataset e gerou faces falsas usando um gerador de imagens. Em seguida, as reflexões nos olhos dessas imagens foram examinadas utilizando o CAS system e o Gini index. A premissa básica é que fotografias autênticas apresentam uma física consistente, onde as reflexões nos olhos devem ser semelhantes, embora não idênticas. As discrepâncias sutis nas reflexões podem indicar manipulação digital.

Os resultados da pesquisa revelaram que o Gini index foi mais eficaz do que o CAS system na previsão de imagens manipuladas. Owolabi conseguiu prever corretamente se uma imagem era falsa em cerca de 70% das vezes, uma taxa significativa, mas que ainda deixa margem para melhorias. O Gini index, ao medir a desigualdade na distribuição de luz, mostrou-se mais sensível às inconsistências introduzidas pelos algoritmos de deepfake, enquanto o CAS system, embora útil, não alcançou o mesmo nível de precisão.

Apesar das limitações, como a ocorrência de falsos positivos e negativos, esta abordagem representa um avanço promissor na detecção de deepfakes. A pesquisa sugere que a combinação de diferentes técnicas pode aumentar a robustez dos métodos de detecção, complementando as ferramentas existentes e potencialmente elevando a precisão geral. A capacidade de detectar anomalias sutis na física da luz em imagens pode ser uma adição valiosa ao arsenal de técnicas utilizadas para combater a disseminação de desinformação e proteger a integridade das informações visuais.

A recepção da pesquisa que utiliza técnicas astronômicas para detectar deepfakes tem sido mista, mas amplamente positiva. Brant Robertson, um astrofísico da Universidade da Califórnia, Santa Cruz, elogia a inovação da abordagem, mas adverte sobre um possível efeito colateral: a mesma métrica que quantifica a realismo de uma imagem deepfake pode ser usada para treinar modelos de IA a criar deepfakes ainda mais convincentes. Essa observação ressalta a natureza dinâmica e em constante evolução da batalha contra a desinformação digital.

Zhiwu Huang, um pesquisador de IA na Universidade de Southampton, Reino Unido, oferece uma perspectiva complementar. Embora seu próprio trabalho não tenha identificado padrões inconsistentes de luz nos olhos em imagens deepfake, ele reconhece o valor das técnicas astronômicas para analisar anomalias sutis em iluminação, sombras e reflexos em diferentes partes de uma imagem. Huang sugere que detectar inconsistências nas propriedades físicas da luz pode complementar os métodos existentes e melhorar a precisão geral da detecção de deepfakes.

A relevância dessa pesquisa transcende o campo da astronomia e toca em questões cruciais para a sociedade contemporânea. Em um mundo onde a desinformação pode ser facilmente disseminada, especialmente durante períodos críticos como eleições, a capacidade de distinguir imagens reais de falsas é de suma importância. Deepfakes têm o potencial de minar a confiança pública, manipular opiniões e até mesmo comprometer a segurança nacional. Portanto, métodos robustos de detecção são essenciais para preservar a integridade das informações.

A aplicação de técnicas astronômicas para resolver problemas de detecção de deepfakes representa um avanço significativo. Ao explorar métodos que quantificam a distribuição de luz, como o CAS system e o Gini index, os pesquisadores estão abrindo novas fronteiras na luta contra a manipulação digital. Essa abordagem interdisciplinar não só amplia o escopo das ferramentas disponíveis, mas também demonstra como conhecimentos de diferentes áreas da ciência podem ser integrados para enfrentar desafios modernos.

Em resumo, a pesquisa liderada por Kevin Pimbblet e Adejumoke Owolabi oferece uma nova perspectiva sobre a detecção de deepfakes, utilizando técnicas astronômicas para analisar reflexos de luz nos olhos. Embora ainda haja desafios a serem superados, como a possibilidade de falsos positivos e negativos, os resultados preliminares são promissores. A comunidade científica reconhece tanto o potencial quanto as limitações dessa abordagem, sugerindo que ela pode complementar os métodos existentes e contribuir para a criação de ferramentas mais eficazes.

À medida que a tecnologia de deepfakes continua a evoluir, a necessidade de métodos de detecção igualmente avançados se torna cada vez mais urgente. A integração de técnicas astronômicas representa um passo importante nessa direção, oferecendo novas maneiras de identificar manipulações sutis e proteger a integridade das informações. O futuro da detecção de deepfakes pode muito bem depender da colaboração entre disciplinas, unindo astronomia, inteligência artificial e ciência de dados em uma frente comum contra a desinformação.

Fonte:

Comente!